Огромную NVIDIA GeForce RTX 4090 сравнили с собакой: опубликованы фото графического ускорителя

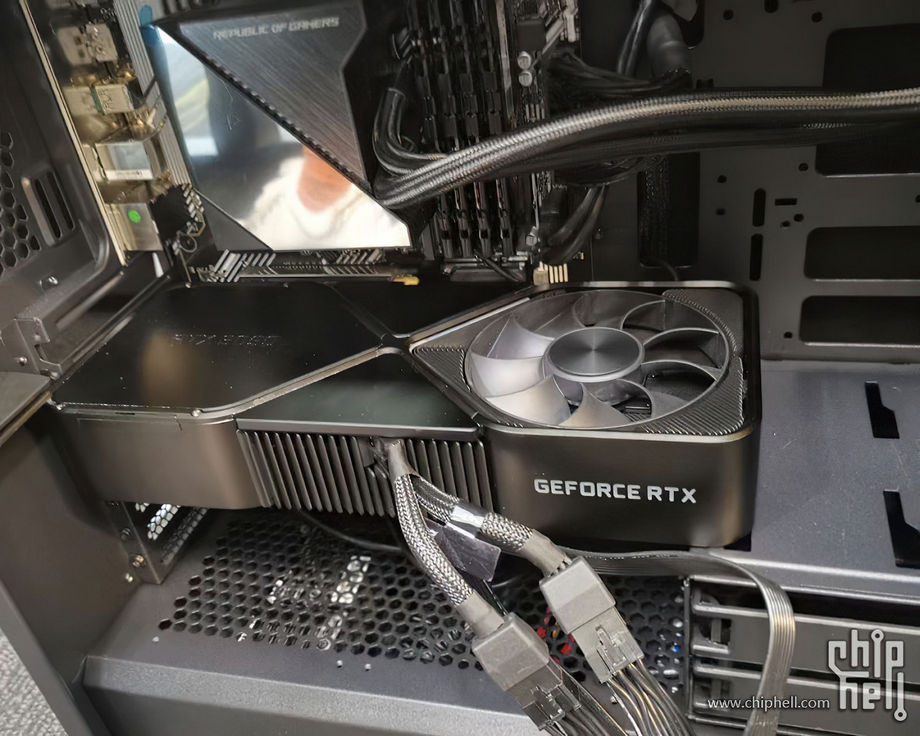

Современная видеокарта NVIDIA GeForce RTX 4090 выглядит довольно массивной, что породило соответствующие шутки

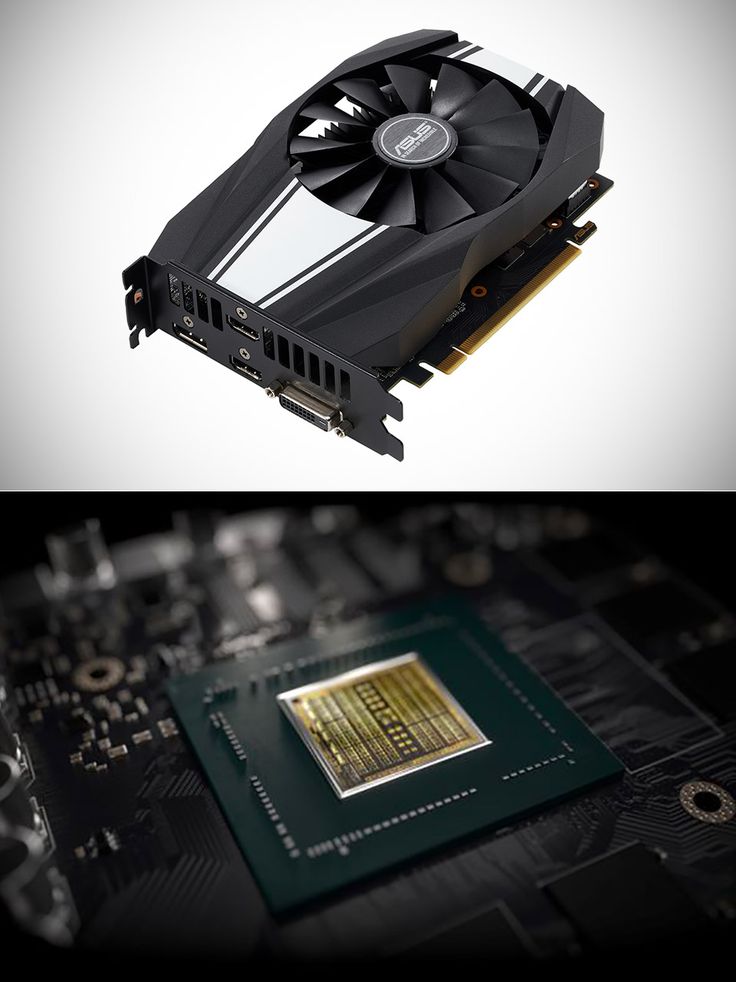

В сети появились новые фото NVIDIA GeForce RTX 4090. Видеокарта явно выделятся габаритами.

Журналисты Wccftech опубликовали несколько фото видеокарты NVIDIA GeForce RTX 4090 и упаковки.

Редактор The Verge Том Уоррен (Tom Warren) для контраста усадил рядом с новинкой собаку.

Также Том сравнил NVIDIA GeForce RTX 4090 и GeForce RTX 3090, новинка расположилась снизу и оказалась чуть короче предшественницы.

Сравнение с Xbox и PlayStation 5.

2022-10-05 20:59:41

Борис ПилецкийПохоже, CD Projekt RED готовит выживание по The Witcher с процедурной генерацией мира и отказалась от мобильных продуктов

Блогер построил в Minecraft вселенную с чёрной дырой и планетами. Пришлось улучшать компьютер, чтобы всё построить

Новости

Публикации

Удаляйте Vanguard. Обзор мультиплеера Call of Duty: Modern Warfare 2

За пределами сюжетной кампании с клюквой и коричневой моралью, в Modern Warfare 2 есть многопользовательский режим, ради которого многие ежегодно и исправно покупают Call of Duty

Что и как изменили.

Скандинавская мифология в God of War: Ragnarok

Скандинавская мифология в God of War: Ragnarok

В основе дилогии перезапуска франшизы God of War лежит скандинавская мифология. Что-то разработчики взяли прямиком из стихов Сэмунда Мудрого и Снорри Стурлусона — Старшей и Младшей Эдд. Но придумали много и своего, сделав мифологию северных народов ещё насыщеннее. В этой статье мы и разберемся, какие события происходили в каноничных стихах и что изменили Santa-Monica в God of War.

Ради таких игр покупают консоли. Альтернативное мнение о God of War: Ragnarok

Как Sony Santa-Monica удалось сделать настолько похожую, но другую, нежели перезапуск 2018 года, игру — загадка. Вроде бы скелет проекта остался тем же, а вот мышцы подкачали. Причём не только те, которые отвечают за силу, но и за мыслительную деятельность. Каждая ниточка истории подвязана с мифологией и вселенной God of War, каждый игровой элемент в нужном месте, а графика и музыка кладут игрока на лопатки в каждой сцене — такими должны быть современные одиночные игры.

Тоска. Обзор God of War Ragnarok

Иронично, но Бога войны в игре с названием God of War нет от слова совсем. Местами Ragnarok напоминает какое-то ток-шоу, в котором люди с проблемным прошлым рассказывают, как их в детстве били родители и не любили сверстники, из-за чего они выросли злобными

Вайфу-фактор. Обзор мобильного шутера Goddess of Victory: Nikke

Новый мобильный боевик от корейских разработчиков быстро завоевал миллионную аудиторию. Всего за одну неделю на смартфоны проект был установлен 10 миллионов раз, а оценки игры в мобильных маркетплейсах по-хорошему удивляют. Не спешите списывать этот успех на красивых вайфу, то есть, аниме-девушек. Игра цепляет хорошо настроенным геймплеем, хоть и увлекательным только на короткое время.

GeForce RTX 4080 оказалась почти такой же огромной, как RTX 4090. Фото видеокарт разрушают надежды фанатов NVIDIA

Некоторые поклонники продуктов NVIDIA отложили покупку современной видеокарты GeForce RTX 4090 из-за огромных размеров. Надеялись, что с RTX 4080 всё будет иначе

Надеялись, что с RTX 4080 всё будет иначе

В сети начали появляться фото видеокарты GeForce RTX 4080. Как и в случае с NVIDIA GeForce RTX 4090, размер впечатляет.

Судя по имеющимся кадрам продукции Asus, Gigabyte, Galax и Colorful — не только GeForce RTX 4090 может похвастаться внушительными размерами.

Для охлаждения GeForce RTX 4080 используют три вентилятора, а толщина таких видеокарт чуть меньше четырёх слотов.

В GeForce RTX 4080 используют 16-pin разъём, который получил скандальную репутацию из-за инцидентов с GeForce RTX 4090.

2022-11-09 14:03:03

Борис ПилецкийFromSoftware вернула онлайн в Dark Souls Remastered на ПК

Warhammer 40,000 Darktide вернулась в российский Steam, новая PS5 — самое интересное за 8 ноября

Новости

Публикации

Удаляйте Vanguard.

Обзор мультиплеера Call of Duty: Modern Warfare 2

Обзор мультиплеера Call of Duty: Modern Warfare 2

За пределами сюжетной кампании с клюквой и коричневой моралью, в Modern Warfare 2 есть многопользовательский режим, ради которого многие ежегодно и исправно покупают Call of Duty

Что и как изменили. Скандинавская мифология в God of War: Ragnarok

В основе дилогии перезапуска франшизы God of War лежит скандинавская мифология. Что-то разработчики взяли прямиком из стихов Сэмунда Мудрого и Снорри Стурлусона — Старшей и Младшей Эдд. Но придумали много и своего, сделав мифологию северных народов ещё насыщеннее. В этой статье мы и разберемся, какие события происходили в каноничных стихах и что изменили Santa-Monica в God of War.

Ради таких игр покупают консоли. Альтернативное мнение о God of War: Ragnarok

Как Sony Santa-Monica удалось сделать настолько похожую, но другую, нежели перезапуск 2018 года, игру — загадка. Вроде бы скелет проекта остался тем же, а вот мышцы подкачали. Причём не только те, которые отвечают за силу, но и за мыслительную деятельность. Каждая ниточка истории подвязана с мифологией и вселенной God of War, каждый игровой элемент в нужном месте, а графика и музыка кладут игрока на лопатки в каждой сцене — такими должны быть современные одиночные игры.

Вроде бы скелет проекта остался тем же, а вот мышцы подкачали. Причём не только те, которые отвечают за силу, но и за мыслительную деятельность. Каждая ниточка истории подвязана с мифологией и вселенной God of War, каждый игровой элемент в нужном месте, а графика и музыка кладут игрока на лопатки в каждой сцене — такими должны быть современные одиночные игры.

Тоска. Обзор God of War Ragnarok

Иронично, но Бога войны в игре с названием God of War нет от слова совсем. Местами Ragnarok напоминает какое-то ток-шоу, в котором люди с проблемным прошлым рассказывают, как их в детстве били родители и не любили сверстники, из-за чего они выросли злобными

Вайфу-фактор. Обзор мобильного шутера Goddess of Victory: Nikke

Новый мобильный боевик от корейских разработчиков быстро завоевал миллионную аудиторию. Всего за одну неделю на смартфоны проект был установлен 10 миллионов раз, а оценки игры в мобильных маркетплейсах по-хорошему удивляют. Не спешите списывать этот успех на красивых вайфу, то есть, аниме-девушек. Игра цепляет хорошо настроенным геймплеем, хоть и увлекательным только на короткое время.

Не спешите списывать этот успех на красивых вайфу, то есть, аниме-девушек. Игра цепляет хорошо настроенным геймплеем, хоть и увлекательным только на короткое время.

Riva Speech AI SDK | NVIDIA Developer

NVIDIA® Riva — это SDK голосового ИИ с ускорением на графическом процессоре для создания и развертывания полностью настраиваемых конвейеров искусственного интеллекта в реальном времени, обеспечивающих точность мирового уровня во всех облаках, локально, на периферии и на встроенных устройствах.

ЗагрузитьВводные ресурсы

Узнайте о преимуществах NVIDIA Riva.

Создан на основе передового искусственного интеллекта NVIDIA

Riva является частью платформы искусственного интеллекта NVIDIA, которая была создана на основе десятилетних инноваций NVIDIA в области искусственного интеллекта в отношении архитектур моделей, методов обучения, оптимизации логических выводов и решений для развертывания. .

.

Полностью настраиваемый

Гибкость на каждом этапе, от изменения архитектуры моделей до точной настройки моделей на ваших данных и настройки конвейеров, а также возможность развертывания на любой платформе.

Высочайшая производительность

Непрерывная оптимизация всего стека, от моделей до программного и аппаратного обеспечения, позволила добиться 12-кратного прироста по сравнению с предыдущим поколением.

Речевой ИИ мирового уровня

Поскольку голосовые приложения используются во всем мире, решения должны взаимодействовать с людьми на многих языках. Приложения речевого ИИ должны понимать отраслевой жаргон и естественно реагировать в режиме реального времени. Riva включает в себя автоматическое распознавание речи (ASR) и преобразование текста в речь (TTS) мирового класса, которые работают в режиме реального времени.

Попробуйте автоматическое распознавание речи NVIDIA Riva.

В этой демонстрации Riva ASR обеспечивает высокоточную транскрипцию в режиме реального времени.

Вы можете вводить данные через микрофон или загружать файл .wav со своего устройства.

Продолжительность каждой выборки ограничена 30 секундами.

Язык Английский (en-US)Испанский (es-US)Немецкий (de-DE)Русский (ru-RU)

Попробуйте сказать что-нибудь

Загрузить .wav

Попробуйте преобразование текста в речь NVIDIA Riva.

Если вы хотите добавить голос к своему интерактивному виртуальному помощнику, современному домашнему устройству или помощнику по чтению для людей с нарушениями чтения или зрения, попробуйте готовый (OOTB) английский женский или мужской голос Riva. .

Услышьте человеческие выразительные голоса, созданные с помощью ультрасовременных (SOTA) моделей нейронного синтеза речи Riva.

Голос

0 / 400

Использование вами Riva Voice Recognition и Riva Text-to-Speech регулируется нашими Условиями использования. Ваши данные будут использованы для улучшения продуктов и услуг NVIDIA.

Ваши данные будут использованы для улучшения продуктов и услуг NVIDIA.

, специфичный для домена автоматический

распознавание речи

Контролируемый

Текст до речи

Что такое NVIDIA RIVA?

Простой сквозной рабочий процесс для приложений голосового ИИ.

Riva предлагает:

- Предварительно обученные речевые AI-модели SOTA: Модели ASR и TTS, полностью настраиваемые для наборов данных и ускоряющие разработку предметно-ориентированных моделей в 10 раз.

- Высокопроизводительный инференс: Инференс основан на оптимизации NVIDIA TensorRT™ и обслуживается сервером инференса NVIDIA Triton™, которые являются компонентами платформы искусственного интеллекта NVIDIA.

- Сервисы Riva: Доступны в виде микросервисов на основе gRPC для потоковой передачи с малой задержкой и высокопроизводительных автономных вариантов использования.

- Высокая масштабируемость: Полностью контейнеризованная, Riva может легко масштабироваться до сотен и тысяч параллельных потоков.

Узнайте больше о Riva ASR.

Технология распознавания речи обеспечивает голосовой поиск в Интернете, работу в режиме громкой связи, голосовые команды для устройств «умный дом» и помощников в автомобиле, ведение медицинских записей, контакт-центр Круглосуточные виртуальные помощники, а также расшифровки телефонных звонков и видеоконференций для анализа шаблонов и тенденций. Автоматическое распознавание речи (ASR) NVIDIA Riva обеспечивает первоклассные и точные расшифровки на основе моделей, оптимизированных для графического процессора, полностью настраиваемых для любого домена или платформы развертывания.

Основные функции Riva ASR включают:

- Поддержка английского, испанского, китайского, хинди, русского, немецкого и французского языков

- Готовые модели, обученные на различных сотни тысяч часов на графических процессорах NVIDIA

- Максимально возможная точность для разных языков, акцентов, доменов, словарного запаса и контекста за счет точной настройки словарного запаса, лексики, акустики, языка, пунктуации и моделей нормализации обратного текста

- Возможность возвращать расшифровки потоковой передачи с автоматической расстановкой знаков препинания и временными метками мирового уровня для сотен тысяч входных аудиопотоков

- Фильтрация слов/ненормативной лексики с настраиваемым и эффективным удалением оскорбительных произнесенных слов

Узнайте больше о Riva TTS .

Преобразование текста в речь производит голоса, которые озвучивают электронные книги и документы, общаются с людьми в качестве интеллектуальных помощников или цифровых аватаров и являются частью почти всех цифровых устройств, включая смартфоны, планшеты и ноутбуки. Преобразование текста в речь (TTS) NVIDIA Riva обеспечивает синтетические голоса, подобные человеческим, на основе современных моделей генерации спектрограмм и вокодера. Конвейеры TTS настраиваются и оптимизированы для графического процессора для эффективной работы в режиме реального времени.

Преобразование текста в речь (TTS) NVIDIA Riva обеспечивает синтетические голоса, подобные человеческим, на основе современных моделей генерации спектрограмм и вокодера. Конвейеры TTS настраиваются и оптимизированы для графического процессора для эффективной работы в режиме реального времени.

Ключевые особенности Riva TTS включают:

- Модели SOTA для создания выразительных голосов, похожих на человеческие

- Два готовых профессиональных женских и мужских голоса для американского английского

- Легкость голоса и акцент -настройка с управлением высотой тона, громкостью и длительностью для выразительности

- 12-кратное повышение производительности логических выводов по сравнению с существующими технологиями

Ускорьте свое знакомство с Riva с NVIDIA LaunchPad

Получите немедленный доступ к NVIDIA Riva с бесплатными кураторскими лабораториями. Получите доступ к пошаговым лабораторным занятиям по речевому ИИ с готовым программным обеспечением, образцами данных и приложениями.

Получите доступ к пошаговым лабораторным занятиям по речевому ИИ с готовым программным обеспечением, образцами данных и приложениями.

Прочитайте истории клиентов.

С помощью NVIDIA Riva компания RingCentral достигла непревзойденной точности транскрибирования в режиме реального времени для видеоконференций, обслуживая миллионы пользователей по всему миру с разными акцентами и специфическим жаргоном.

Узнать больше

T-Mobile использует NVIDIA Riva ASR в своем колл-центре для точной расшифровки разговоров с клиентами и предоставления агентам рекомендаций в режиме реального времени для быстрого решения запросов клиентов.

Узнать больше

Tarteel использует NVIDIA Riva и NVIDIA NeMo для обеспечения обратной связи в режиме реального времени при чтении Корана в любом масштабе, что позволяет мусульманам, преподавателям, создателям контента и исследователям взаимодействовать с Кораном.

Узнать больше

Data Monsters добавили речевой конвейер для приложения Plabook с использованием NVIDIA Riva, чтобы помочь учащимся читать, оценивать точность на уровне фонемы и предоставлять индивидуальную обратную связь.

Узнать больше

Floatbot использует NVIDIA Riva и NVIDIA TAO для своих настраиваемых сингапурских английских голосовых приложений с искусственным интеллектом, автоматизируя колл-центры для страховых компаний и финансовых клиентов по всему миру.

Подробнее

Узнайте больше о ресурсах.

Знакомство.

Узнайте об основных функциях Riva, которые помогут вам создавать сервисы голосового ИИ.

Читать блог

Изучите стартовый комплект.

Получите все необходимое, чтобы приступить к разработке речевого ИИ с помощью NVIDIA Riva, включая учебные пособия, блокноты Jupyter и документацию.

Начало работы

Посмотреть вебинар.

Узнайте, как можно использовать ИИ NVIDIA для создания приложений речевого ИИ, которые обеспечивают точность мирового уровня при работе в реальном времени с тысячами потоков.

Смотреть сейчас

NVIDIA Riva доступна в NVIDIA GPU Cloud для участников программы NVIDIA Developer Program.

Инновационный искусственный интеллект для улучшения изображений с помощью графических процессоров NVIDIA и GKE

Количество цифровых изображений, создаваемых и используемых как для личных, так и для деловых нужд, стремительно растет. Например, на платформах электронной коммерции и онлайн-рынках изображения продуктов и визуальные эффекты сильно влияют на восприятие потребителя, принятие решений и, в конечном итоге, на коэффициент конверсии. Кроме того, произошел быстрый сдвиг в сторону пользовательского визуального контента для электронной коммерции — подумайте о изображениях продуктов, созданных продавцами, фотографиях арендуемой недвижимости, созданных хостами, и контенте, созданном влиятельными лицами в социальных сетях. Соревнование? Эти созданные пользователями изображения часто снимаются с помощью мобильных камер и сильно различаются по размеру, качеству, степени сжатия и разрешению, что затрудняет для компаний предоставление согласованных высококачественных изображений продуктов на их платформах.

Соревнование? Эти созданные пользователями изображения часто снимаются с помощью мобильных камер и сильно различаются по размеру, качеству, степени сжатия и разрешению, что затрудняет для компаний предоставление согласованных высококачественных изображений продуктов на их платформах.

Это именно та проблема, которую Let’s Enhance, стартап в области компьютерного зрения с командами из США и Украины, намеревался решить с помощью ИИ. Платформа Let’s Enhance автоматически улучшает качество любых фотографий, созданных пользователями, с помощью функций на основе искусственного интеллекта для улучшения изображений за счет автоматического масштабирования, устранения пикселизации и размытия, коррекции цвета и слабого освещения, а также удаления артефактов сжатия — и все это одним щелчком мыши и без профессиональное оборудование или фоторедакторы.

«Let’s Enhance.io разработан как простая платформа, которая предоставляет визуальные технологии на основе искусственного интеллекта всем — от маркетологов и предпринимателей до фотографов и дизайнеров», сказала Софи Швец, генеральный директор и соучредитель Let’s Enhance.

На сегодняшний день Let’s Enhance обработала более 100 миллионов фотографий для миллионов клиентов по всему миру для различных вариантов использования, от цифровых художественных галерей, агентств недвижимости, цифровой печати, электронной коммерции и онлайн-рынков. С введением Claid.ai, их нового API для автоматического улучшения и оптимизации пользовательского контента в масштабе для цифровых торговых площадок, им нужно было ежемесячно обрабатывать миллионы изображений и справляться с внезапными пиками пользовательского спроса.

Однако создание и развертывание службы с поддержкой ИИ в масштабе для глобального использования — это огромная техническая задача, которая включает в себя построение модели, обучение, обслуживание логических выводов и масштабирование ресурсов. Для этого требуется инфраструктура, которой легко управлять и отслеживать, которая может обеспечивать производительность в режиме реального времени для конечных клиентов, где бы они ни находились, и может масштабироваться в соответствии с пиковыми потребностями пользователей, при этом оптимизируя расходы.

Чтобы поддержать свою растущую базу пользователей, Let’s Enhance решила развернуть свою платформу на основе ИИ для производства в Google Cloud и NVIDIA. Но прежде чем углубиться в их решение, давайте внимательно рассмотрим технические проблемы, с которыми они столкнулись при достижении своих бизнес-целей.

Разработка решения для следующей волны роста и инноваций

Для предоставления высококачественных улучшенных изображений, которые видят конечные клиенты, продукты Let’s Enhance основаны на передовых глубоких нейронных сетях (DNN), которые одновременно являются вычислительными и интенсивное использование памяти. Хотя построение и обучение этих моделей DNN само по себе является сложным итеративным процессом, производительность приложения — например, при обработке новых пользовательских запросов — имеет решающее значение для обеспечения качественного взаимодействия с конечным пользователем и снижения общих затрат на развертывание.

Один запрос на вывод или обработку, т. е. из созданного пользователем изображения, которое может сильно различаться по размеру, на входе в выходное изображение с улучшенным ИИ, требует объединения нескольких моделей DNN в сквозном конвейере. Основные показатели производительности логического вывода, которые следует оптимизировать, включая задержку (время, которое требуется от предоставления входного изображения до получения расширенного изображения) и пропускную способность (количество изображений, которые могут быть обработаны в секунду).

е. из созданного пользователем изображения, которое может сильно различаться по размеру, на входе в выходное изображение с улучшенным ИИ, требует объединения нескольких моделей DNN в сквозном конвейере. Основные показатели производительности логического вывода, которые следует оптимизировать, включая задержку (время, которое требуется от предоставления входного изображения до получения расширенного изображения) и пропускную способность (количество изображений, которые могут быть обработаны в секунду).

Вместе, Google Cloud и Технологии NVIDIA предоставили все элементы, необходимые команде Let’s Enhance для роста и масштабирования. В стеке решения было три основных компонента:

-

Compute Resources : A2 VMS, Powered By Nvidia A100 Tensor Core GPU

-

Управление инфраструктурой : Google Kubernetes Engine (GKE)

- 9002 waterning inemine (GKE)

- 9002 .

Повышение пропускной способности и снижение затрат с помощью многоэкземплярных графических процессоров (MIG) NVIDIA A100 в Google Cloud

Чтобы удовлетворить вычислительные требования моделей DNN и обеспечить конечным пользователям производительность логического вывода в реальном времени, Let’s Enhance выбрала виртуальные машины Google Cloud A2.

на базе графических процессоров NVIDIA A100 с тензорными ядрами в качестве вычислительной инфраструктуры. Функция Multi-Instance GPU (MIG) графического процессора A100 предоставила им уникальную возможность разделить один графический процессор на два независимых экземпляра и одновременно обрабатывать два пользовательских запроса, что позволяет обслуживать больший объем пользовательских запросов при одновременном снижении общего количества запросов. затраты на развертывание.

на базе графических процессоров NVIDIA A100 с тензорными ядрами в качестве вычислительной инфраструктуры. Функция Multi-Instance GPU (MIG) графического процессора A100 предоставила им уникальную возможность разделить один графический процессор на два независимых экземпляра и одновременно обрабатывать два пользовательских запроса, что позволяет обслуживать больший объем пользовательских запросов при одновременном снижении общего количества запросов. затраты на развертывание. Инстансы A100 MIG продемонстрировали повышение пропускной способности в среднем на 40 % по сравнению с графическими процессорами NVIDIA V100 с увеличением до 80 % для определенных конвейеров улучшения изображения, использующих такое же количество узлов для развертывания. Благодаря повышению производительности за счет пулов узлов того же размера компания Let’s Enhance отметила снижение затрат на 34 % при использовании графических процессоров A100 с поддержкой MIG.

Упрощенное управление инфраструктурой с помощью GKE

Чтобы предложить своим клиентам гарантированное качество обслуживания (QoS) и управлять пользовательским спросом, Let’s Enhance необходимо выделять базовые вычислительные ресурсы, управлять ими и масштабировать их, сохраняя при этом высокий уровень использования и низкие затраты.

GKE предлагает лучшие в отрасли возможности для обучения и получения выводов, такие как поддержка 15 000 узлов на кластер, автоматическая инициализация, автоматическое масштабирование и различные типы машин (например, ЦП, ГП и по запросу, точечные), что делает его идеальным выбором. для Let’s Enhance.

Благодаря поддержке графических процессоров NVIDIA и возможностям совместного использования графических процессоров NVIDIA GKE может выделять несколько экземпляров A100 MIG для параллельной обработки пользовательских запросов и максимального использования ресурсов. По мере увеличения объема вычислений, необходимых для развернутых конвейеров машинного обучения (например, внезапный всплеск запросов на обслуживание), GKE может автоматически масштабироваться до дополнительных пулов узлов с разделами MIG, предлагая более точную детализацию для предоставления ускорения графического процессора нужного размера для рабочих нагрузок все размеры.

«Наша общая усредненная пропускная способность варьировалась от 10 до 80 изображений в секунду.

Благодаря поддержке NVIDIA A100 MIG и механизмам автоматического масштабирования в GKE мы теперь можем масштабировать это до 150 изображений в секунду и более в зависимости от потребностей пользователей и доступности графического процессора», — сказал Влад Пранскявичюс, соучредитель и технический директор, Let’s Enhance. .

Благодаря поддержке NVIDIA A100 MIG и механизмам автоматического масштабирования в GKE мы теперь можем масштабировать это до 150 изображений в секунду и более в зависимости от потребностей пользователей и доступности графического процессора», — сказал Влад Пранскявичюс, соучредитель и технический директор, Let’s Enhance. . Кроме того, поддержка GKE динамического планирования, автоматизированного обслуживания и обновлений, высокой доступности, API заданий, настраиваемости и отказоустойчивости упростила управление средой развертывания в производственной среде, что позволило команде Let’s Enhance сосредоточиться на создании передовых конвейеров машинного обучения.

Высокопроизводительное обслуживание логических выводов с помощью NVIDIA Triton Inference Server

Чтобы оптимизировать производительность и упростить развертывание своих моделей DNN в пулах узлов, управляемых GKE, экземпляров NVIDIA A100 MIG, компания Let’s Enhance выбрала открытый исходный код NVIDIA Triton Inference Server, который развертывает, запускает и масштабирует модели ИИ из любой среды в любую инфраструктуру на основе графического процессора или процессора.

Поддержка нескольких фреймворков в NVIDIA Triton позволила команде Let’s Enhance обслуживать модели, обученные как TensorFlow, так и PyTorch, избавляя от необходимости настраивать и поддерживать несколько сервисных решений для разных бэкэндов фреймворков. Кроме того, ансамблевая модель Triton и функции общей памяти помогли максимизировать производительность и минимизировать накладные расходы на передачу данных для их сквозного конвейера обработки изображений, который состоит из нескольких моделей и больших объемов необработанных данных изображений, передаваемых между ними.

«Мы увидели более чем 20-процентное повышение производительности с помощью Triton по сравнению с пользовательским кодом обслуживания логических выводов, а также смогли исправить несколько ошибок во время развертывания благодаря функциям самовосстановления Triton», — сказал Влад. «Triton наполнен интересными функциями, и, поскольку я наблюдал за его развитием с самого начала, темпы разработки продукта просто поразительны».

Для дальнейшего повышения производительности сквозного вывода команда использует NVIDIA TensorRT, SDK для оптимизации обученных моделей для развертывания с максимальной пропускной способностью и минимальной задержкой при сохранении точности прогнозов.

«С подмножеством наших моделей, которые мы конвертировали из Tensorflow в NVIDIA TensorRT, мы наблюдали ускорение от 10% до 42%, в зависимости от модели, что впечатляет», — сказал Влад. «Для моделей с интенсивным использованием памяти, таких как наша, мы также смогли добиться предсказуемого потребления памяти, что является еще одним большим преимуществом использования TensorRT, помогая предотвратить любые непредвиденные проблемы, связанные с памятью, во время производственного развертывания».

Работа в команде делает мечту реальностью

С помощью Google Cloud и NVIDIA компания Let’s Enhance решила проблемы обслуживания логических выводов в реальном времени и управления инфраструктурой, чтобы масштабировать свои услуги с поддержкой искусственного интеллекта в безопасной инфраструктуре Google Cloud.

GKE, программное обеспечение NVIDIA AI и виртуальные машины A2 на базе графических процессоров NVIDIA A100 объединили все элементы, необходимые для обеспечения желаемого пользовательского опыта и создания решения, которое может динамически масштабировать свои сквозные конвейеры в зависимости от требований пользователя.

Тесное сотрудничество с командой Google Cloud и NVIDIA на каждом этапе также помогло Let’s Enhance быстро вывести свое решение на рынок. «С командами Google Cloud и NVIDIA работать невероятно. Они высокопрофессиональны, всегда отзывчивы и искренне заботятся о нашем успехе», — сказал Влад. «Мы смогли получить технические советы и рекомендации непосредственно от команды разработчиков и специалистов по продуктам Google Cloud, а также у нас появился канал для обмена отзывами о продуктах Google Cloud, что было очень важно для нас».

Имея прочную основу и архитектуру решений, которые могут удовлетворить их растущие бизнес-потребности, Let’s Enhance движется к своей цели — сделать цифровые изображения с улучшенным ИИ доступным для всех.

Фото nvidia: NVIDIA Ansel | Руководство пользователя

Фото nvidia: NVIDIA Ansel | Руководство пользователя