Основные характеристики матрицы фотоаппарата

Главная » Теория фотографии » Устройство фотоаппарата

Устройство фотоаппарата

Современные цифровые фотокамеры имеют довольно хорошее разрешение матриц, по этой причине данный параметр должен являться второстепенным при выборе фотоаппарата. Какие характеристики матрицы фотоаппарата необходимо учитывать при покупке? Ответ на этот вопрос предлагаю рассмотреть в рамках данной статьи.

Содержание

- Динамический диапазон – важная характеристика матрицы фотоаппарата

- Светочувствительность – не менее важная характеристика матрицы фотоаппарата

- Порог чувствительности не менее важная характеристика матрицы фотоаппарата

Динамический диапазон – важная характеристика матрицы фотоаппарата

Условия съемки могут оказаться самыми разнообразными – от яркого солнечного дня, до пасмурного вечера, поэтому в любом кадре будут содержаться как очень светлые, так и очень темные участки.

Следовательно, каждый элемент матрицы должен сохранять как самые незначительные электроны, которые возникают при слабом освещении, так и максимальный заряд, который создается ярким светом. Чем шире динамический диапазон матрицы, тем больше градаций яркости и, соответственно, плавне полутона полученного изображения.

Снимок 1. Узкий динамический диапазон не позволяет передать все оттенки изображения.

Светочувствительность – не менее важная характеристика матрицы фотоаппарата

Светочувствительность матрицы – это способность реагировать на излучение света. В целом чувствительность матрицы можно разделить на две составляющие:

- интегральная чувствительность;

- спектральная чувствительность.

Обе эти чувствительности зависят от фототока ПЗС – элемента.

Порог чувствительности не менее важная характеристика матрицы фотоаппарата

Светочувствительность измеряется в единицах ISO и, как правило, имеет относительные значения от 50 единиц и выше.

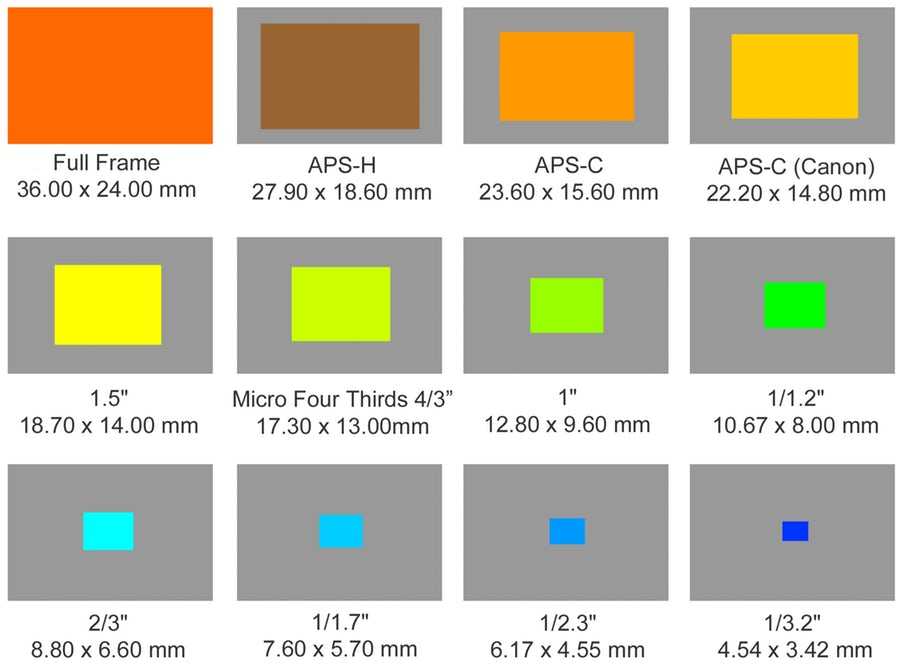

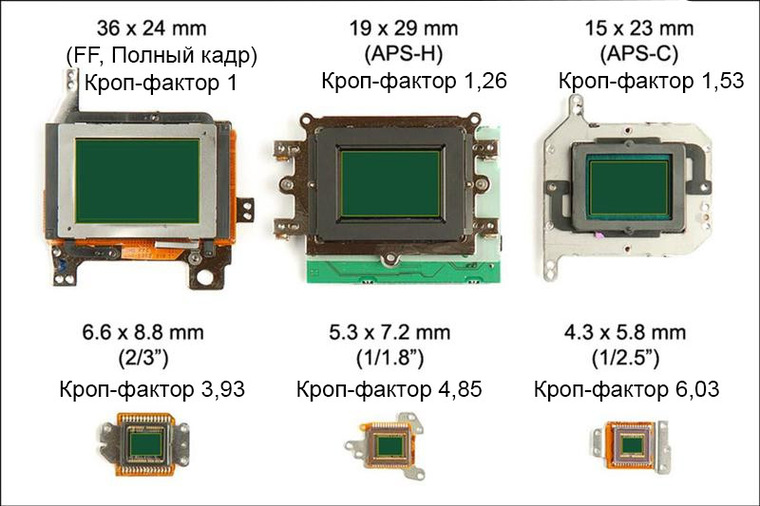

Абсолютная чувствительность величина, зависящая от линейных размеров матрицы. Чувствительность тем меньше, чем меньше размеры ПЗС – матрицы. С ростом относительной светочувствительности начинает расти уровень шумов матрицы.

Шумы на снимке выглядят как множество ярких точек, которые резко отличаются от средних цветов для данного участка изображения. Шум очень хорошо заметен на однородных по цвету и яркости снимках. Поэтому рекомендуется при съемке плохо освещенных объектов выставлять минимальные значения светочувствительности по ISO и увеличивать продолжительность выдержки.

Снимок 2. Лавинообразный рост количества шумов при увеличении чувствительности матрицы.

Достоинством цифровых фотоаппаратов является то, что для каждого снимка можно задавать светочувствительность отдельно, как в ручном, так и в автоматическом режиме.

Если проводить аналогии, то повышение чувствительности матрицы есть ни что иное, как обычное усиление сигнала на выходе, подобное тому, как если бы мы стали повышать громкость звука компьютерных колонок, поворачивая ручку регулятора громкости.

Повышение эквивалентной чувствительности обеспечивает нормальную экспозицию в условиях ограничения выдержки и диафрагмы в определенном диапазоне. Фотограф всегда должен помнить, что повышая чувствительность, также увеличивается уровень шумов. По этой причине данную функцию следует рассматривать как резервную и использовать ее только в случаях, когда другие способы не могут дать должного эффекта.

Замена CCD матрицы фотоаппарата — «Golden mir»

Замена CCD матрицы фотоаппарата может потребоваться довольно неожиданно. Только вчера, казалось бы, фотоаппарат работал. А сегодня уже ни чего снять не получается и вместо изображения «квадрат малевича». Такая неисправность свойственна матрицам CCD и является следствием особенности работы матрицы. В отличие от CMOS матриц, с матрицы изготовленной по технологии CCD изображение считывается за раз целиком, а не с каждого пикселя, как у матрицы CMOS. В связи с этим при неисправностях CCD матриц вы лишаетесь изображения сразу всего целиком.

В связи с этим при неисправностях CCD матриц вы лишаетесь изображения сразу всего целиком.

Но совершенно не стоит расстраиваться, если вас настигла такая беда. Специалисты сервисного центра Golden-mir могут выполнить замену матрицы CCD в вашем фотоаппарате в кратчайшие сроки. Сама по себе, эта операция не занимает много времени.

Для выполнения такого ремонта, естественно, необходимо фотоаппарат разобрать. В компактных фотоаппаратах, для осуществления доступа к матрице, может потребоваться демонтировать объектив, вспышку, дисплей и другие модули фотокамеры. В зеркальных фотокамерах для снятия матрицы CCD может потребоваться снять весь модуль mirror box. После замены матрицы CCD, равно как и после просто её снятия и установки на место, обязательно потребуется настройка фотоаппарата.

После замены матрицы CCD фотоаппарат необходимо собрать в обратном порядке. Устанавливаются обратно все снятые элементы и модули фотокамеры, подключаются к платам все шлейфа и после проверки работоспособности собирается корпус фотокамеры.

Выполнить замену матрицы CCD дома «на коленях» можно только при наличии необходимого инструмента и знаний. Но успех такой операции очень сомнительный. При неквалифицированной разборке фотоаппарата есть большой шанс повредить разъёмы на платах, порвать тонкие шлейфики и нарушить работу оптики камеры. Не стоит испытывать своё везение и прочность камеры. Лучше сразу обратиться в сервисный центр, где вам смогут помочь.

Контактная информация — 8 (903) 789 54 70 г. Москва ул. Сущевский вал дом 5, стр. 12, м. Савёловская, ТЦ «Савёловский», Мобильный ряд, павильон Л-173. понедельник — пятница — 10.00-20.30 суббота — воскресенье — 10.00-19.00

Похожие материалы (по тегу)

- Проверка счётчика затвора зеркального фотоаппарата

- Замена модуля затвора в сборе

- Замена ПЗС матрицы фотоаппарата

- Замена CMOS матрицы фотоаппарта

- Чистка матрицы зеркального фотоаппарата

Другие материалы в этой категории: « Замена CMOS матрицы фотоаппарта Замена ПЗС матрицы фотоаппарата »

НаверхCookies are short reports that are sent and stored on the hard drive of the user’s computer through your browser when it connects to a web.

There are several types of cookies:

- Technical cookies that facilitate user navigation and use of the various options or services offered by the web as identify the session, allow access to certain areas, facilitate orders, purchases, filling out forms, registration, security, facilitating functionalities (videos, social networks, etc..).

- Customization cookies that allow users to access services according to their preferences (language, browser, configuration, etc..).

- Analytical cookies which allow anonymous analysis of the behavior of web users and allow to measure user activity and develop navigation profiles in order to improve the websites.

So when you access our website, in compliance with Article 22 of Law 34/2002 of the Information Society Services, in the analytical cookies treatment, we have requested your consent to their use. All of this is to improve our services. We use Google Analytics to collect anonymous statistical information such as the number of visitors to our site. Cookies added by Google Analytics are governed by the privacy policies of Google Analytics. If you want you can disable cookies from Google Analytics.

All of this is to improve our services. We use Google Analytics to collect anonymous statistical information such as the number of visitors to our site. Cookies added by Google Analytics are governed by the privacy policies of Google Analytics. If you want you can disable cookies from Google Analytics.

However, please note that you can enable or disable cookies by following the instructions of your browser.

Свяжитесь с нами — Мурманский проезд

| г. Москва, Мурманский проезд 1А стр. 1, офис 3.11 А | ||

| 8 (903) 789 54 70 | ||

| Этот адрес электронной почты защищён от спам-ботов. У вас должен быть включен JavaScript для просмотра. |

Ограничение ответственности

Вся представленная на сайте информация, носит информационный характер и ни при каких условиях не является публичной офертой, определяемой положениями Статьи 437(2) Гражданского кодекса РФ.

При обращении в наш Сервисный центр, в том числе с использованием ресурсов сайта и предоставлении каких-либо персональных данных, вы принимаете Согласие на обработку персональных данных. Более подробную информацию можно посмотреть в Политике конфиденциальности.

Матрица камеры | Semantic Scholar

Semantic Scholar использует ИИ для извлечения документов, важных для этой темы.

Нерастяжимая нежесткая форма из движения с помощью программирования конуса второго порядка

Мы представляем глобальную и выпуклую формулу для безшаблонной 3D-реконструкции деформируемого объекта с помощью перспективной камеры…

Высоко цитируемый Использование ручной камеры для 3D-картирования отдельных деревьев на пробных лесных участках

- Xinlian Liang, A. Jaakkola, H. Kaartinen

- Удаленный.

Sens.

Sens. - 2014

- Идентификатор корпуса: 18528425

В этом документе оценивалась возможность создания наземного облака точек с использованием некалиброванной ручной потребительской камеры… Сборка электроники — это преимущественно повторяющиеся ручные операции из-за низких затрат на запуск и высокой…

Глобальное планирование пути для надежного визуального отслеживания в сложных условиях

Мы внедряем глобальное планирование пути на основе выборки с визуальным обслуживанием (VS) для роботизированной руки, оснащенной камерой в руке…

Автоматическая калибровка камеры для трансляций теннисного видео с приложениями для вставки виртуального 3D-контента, обнаружения и отслеживания мячей

- Xinguo Yu, Nianjuan Jiang, L. Cheong, H. Leong, Xin Yan

- Comput.

Вис. Изображение Понимание.

Вис. Изображение Понимание. - 2009

- Идентификатор корпуса: 31172115

Высоко цитируемый

2008

Моделирование взаимосвязей пространства-времени между камерами и внешнего вида для отслеживания непересекающихся видов

- О. Джавед, К. Шафик, З. Шафик, З. Шах

- Вычисл. Вис. Изображение Понимание.

- 2008

- Corpus ID: 6314204

Highly Cited

2006

Spatio-angular resolution tradeoffs in integral photography

- Todor Georgiev, K. Zheng, B. Curless, D. Salesin, S. Nayar, C , Интвала

- EGSR ’06

- 2006

- Идентификатор корпуса: 6593937

Встроенная камера создает четырехмерное световое поле сцены на одной фотографии. В этом документе исследуется фундаментальный компромисс…

В этом документе исследуется фундаментальный компромисс…

Отображение трехмерного изображения с параллаксом движения с помощью матричной стереокамеры

Мы предлагаем систему отображения трехмерного изображения, которая может отображать реальные сцены с реалистичным параллаксом движения. В сенсорной системе сцена…

Часто цитируется

1996

Окклюзия Обнаруживаемые стереофонические шаблоны окклюзии в матрице камеры

В стереоалгоритмах с более чем двумя камерами часто сообщается об улучшении точности, поскольку они устойчивы к… В. Джанг

Эта статья распространяется на трехмерные задачи методом манипулирования пространством камеры. Для… 9 требуется минимум две камеры.0003

IP-камера | Сетевые камеры | 5 МП 3 МП 2 МП

КАМЕРА IP-Безопасности

Matrix подходит для различных отраслей промышленности с рядом IP-камер безопасности (также известных как сетевые камеры) с датчиком Sony STARVIS для лучшего видеонаблюдения. Оснащенные датчиком с задней подсветкой, эти камеры обеспечивают исключительную производительность при слабом освещении, поскольку они создают цветные изображения при освещенности всего 0,01 люкс. Кроме того, он поставляется с технологией True WDR, обеспечивающей постоянное качество изображения в различных условиях освещения, особенно на открытом воздухе и в приемных в офисах, где частое открывание дверей подвергает воздействию яркого солнечного света. Наряду с изображениями высокого разрешения IP-камеры Matrix снижают затраты на хранение, предлагая новейшую технологию сжатия H.265. Кроме того, Adaptive Streaming снижает частоту кадров в зависимости от движения, экономя до 50 % дискового пространства без ущерба для качества.

Оснащенные датчиком с задней подсветкой, эти камеры обеспечивают исключительную производительность при слабом освещении, поскольку они создают цветные изображения при освещенности всего 0,01 люкс. Кроме того, он поставляется с технологией True WDR, обеспечивающей постоянное качество изображения в различных условиях освещения, особенно на открытом воздухе и в приемных в офисах, где частое открывание дверей подвергает воздействию яркого солнечного света. Наряду с изображениями высокого разрешения IP-камеры Matrix снижают затраты на хранение, предлагая новейшую технологию сжатия H.265. Кроме того, Adaptive Streaming снижает частоту кадров в зависимости от движения, экономя до 50 % дискового пространства без ущерба для качества.

Компания Matrix предлагает устойчивые к атмосферным воздействиям IP-камеры, обеспечивающие бесперебойную работу даже при экстремальных рабочих температурах. Эти камеры обеспечивают кристально чистое изображение высокой четкости и в то же время выдерживают суровые условия окружающей среды. Благодаря прочности наши IP-камеры можно использовать как внутри помещений (предпочтительнее купольные камеры), так и снаружи (предпочтительнее цилиндрические камеры).

Благодаря прочности наши IP-камеры можно использовать как внутри помещений (предпочтительнее купольные камеры), так и снаружи (предпочтительнее цилиндрические камеры).

Характеристики

Превосходное качество изображения

Датчики с задней подсветкой для получения четких изображений при слабом освещении

Сжатие видео

В IP-камерах используется новейшая технология сжатия видео H.265

Интеллектуальная видеоаналитика

Обнаружение движения, натяжение провода и обнаружение вторжения

Более высокое поле зрения

Захват большего поля зрения, до 107,6° FOV

Интеллектуальная потоковая передача

Разделение одного потока на несколько разрешений в зависимости от его важности

Адаптивная потоковая передача

Запись с более низкой скоростью передачи данных в период бездействия.

True WDR

Стабильное изображение при различной освещенности

Область интереса

Разрешает потоковую передачу и запись важных областей только из всего изображения

Поддержка NAS

Запись может быть сохранена непосредственно на NAS/FTP 0 Поддержка потоков

Поддержка до четырех различных потоков для просмотра, записи и удаленного мониторинга

Поддержка SD-карт

Локальное хранилище до 512 ГБ

Smart Alerts

Отключение сети, конфликт IP и предупреждение о хранении

Прямые уведомления

Уведомление центра наблюдения по электронной почте, SMS, аудио и оповещения о тревогах и загрузка на NAS/FTP

Отношение сигнал/шум

73 дБ SNR для состояния самое современное качество изображения

СЕРИЯ PROFESSIONAL

IP-камеры серии Matrix Professional созданы специально для требовательных малых предприятий. Эти компактные камеры лучше всего подходят для SOHO и малых и средних предприятий.

Эти компактные камеры лучше всего подходят для SOHO и малых и средних предприятий.

Области применения: розничная торговля, BFSI, транспорт и логистика, научно-исследовательские лаборатории, региональные и филиалы, офисы и т. д.

Профессиональная купольная камера Профессиональная серия Bullet

СЕРИЯ PROJECT

IP-камеры серии Matrix Project специально разработаны и изготовлены для требовательных крупномасштабных корпоративных и проектных приложений.

Области применения: ИТ и Аутсорсинг бизнес-процессов, производство, фармацевтика, здравоохранение, гостиничный бизнес, правительство, корпоративные офисы и т. д.

Купольная серия Project Серия Project Bullet

СЕРИЯ TURRET

Серия Matrix Turret разработана для удовлетворения потребностей крупных предприятий, которым требуются компактные камеры.

Области применения: ИТ-индустрия, банковское дело, гостиничный бизнес, розничная торговля, государственные учреждения.